サイト公開前に知っておきたい事

管理人が当サイトを公開したのが 2014年3月のこと。それから早5年が経ちまして、それなりにウェブマスターとしてSEOやトラブルに対応する知識が蓄積されてきました。

管理人の情報源は日々の経験である事はもちろんのこと、多くは 旧Googleウェブマスター ヘルプ フォーラムに寄せられたさまざまなトラブルとその対処法にあります。

SEOの存在を知ったのが3年前、そこから今日(2019年3月5日)に至るまでほぼ毎日当サイトに直接関係のない投稿にも目を通しております。

すると当然トラブルの傾向が見えてきます。またその時、あるいはこの先やってはいけない事とやるべき事が何となくではありますが見えてきます。

さらに投稿者に対するエキスパートの回答の中にその時のSEO最新情報を得ることもできます。これらを管理人は「人の振り見て我が振り直せ 的SEO」と勝手に呼んでいます。

そこで今回 サイトを新規公開する前に、知っておいて損はないと思う事を論ってみました。知っているのと知らないとでは大違いだと思います。

また当サイトはサーバー機の製作に始まってドメイン取得とDNS登録、ウェブサーバーの構築、HTMLとCSSのコーディングまで一貫して管理人の自作であり、いわゆる自宅サーバーから配信しています。

これから自宅サーバーを構築し、自前のサイトを公開しようと画策している心意気のある方にもきっと何かの役に立つと思います。(2019/03)

注)ここに掲載する内容は商用サイト向けではありません。また技術的な事も掲載していません。ここでいう商用サイトとは広告を掲載している無料ブログも含みます。

2019年3月5日に 旧ウェブマスター ヘルプ フォーラムは ウェブマスターのヘルプ コミュニティへようこそ に移行しています。前者は閲覧専用になり、質問を投稿できるのは後者です。

旧ウェブマスター ヘルプ フォーラムを閲覧するには

新しいコミュニティ フォーラムに移行して以降、旧ウェブマスター ヘルプ フォーラムの URLでアクセスしても新コミュニティにリダイレクト(転送)されるので閲覧できません。

閲覧するには当時投稿された記事の URLでアクセスする必要があるため実質的に旧フォーラムは削除されたのと同じことになっています。

しかし、本当に削除されたわけではないので閲覧することはできます。

例えば、当サイトに残っているテキストリンクから当時の記事にアクセスできます。しかし閲覧できるのはその記事だけでありその他の記事につながるリンクはなく新コミュニティにリダイレクトされます。

現在、旧フォーラムの記事を閲覧するには、新コミュニティのトップページの検索窓にキーワードを入力するしかないようです。

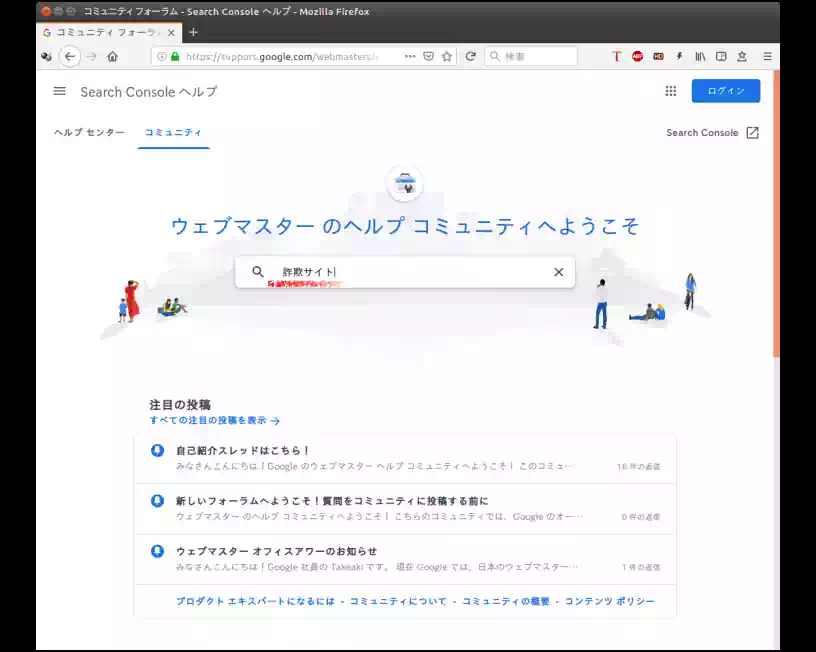

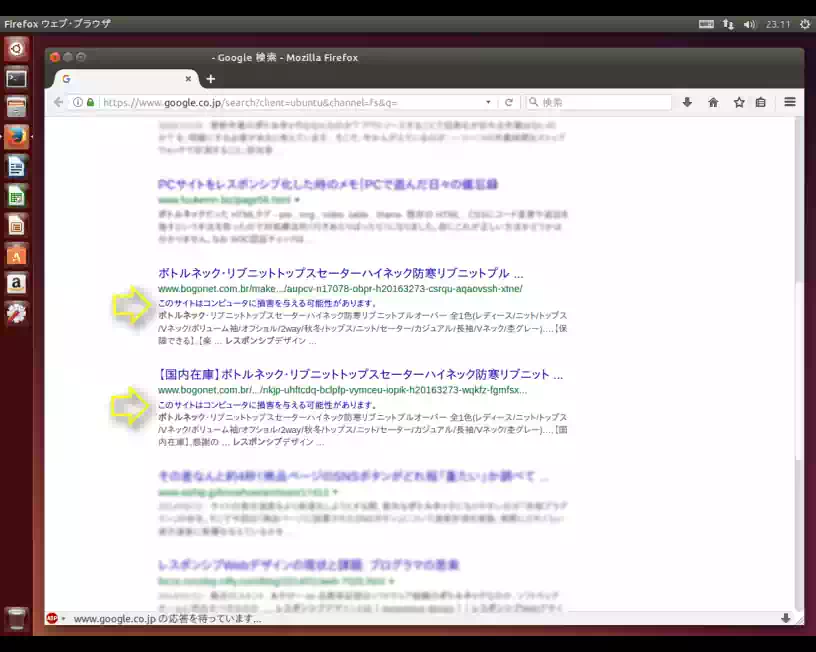

そこで「詐欺サイト」をキーワードに検索してみました。

下の画像は新コミュニティのトップページとキーワード検索の スクリーンショットです。

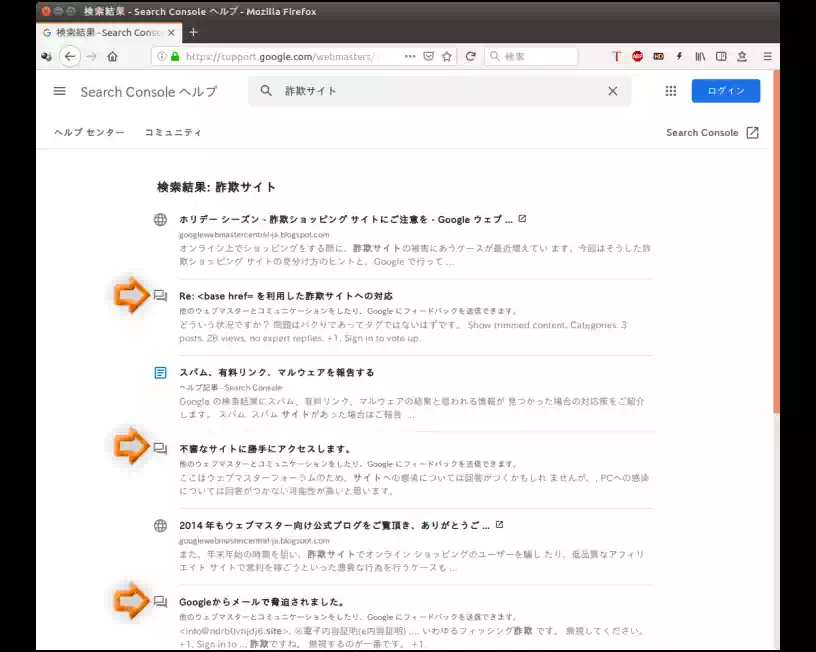

画像中の矢印で示しているアイコンが旧フォーラムに投稿された記事のタイトルです。

そして下の画像が探している記事のスクリーンショットです。こちらは当サイトのリンクからアクセスしたものです。

結果的にこのキーワードに記事のタイトルに含まれるワードを追加してみましたが、新コミュニティの検索窓から目的の記事に辿り着くことはできませんでした。

どうやら全ての過去記事が表示されているわけではないようですね。なお、投稿者と回答者のやり取りは削除されていて投稿内容とベストアンサーだけが表示されます。

管理人はそのやり取りの中に投稿者の苦悩や問題解決したときの歓喜のライブ感に惹かれていたので少し残念な気持ちです。

もう1つ、キーワードが新コミュニティに一致する場合は旧フォーラムの記事は表示されないようでした。

サイトを構築する前に読んでください

ここに記す内容の理解度を深めることをお勧めします。ネット検索すれば幾らでも出てくる情報です。但し、その内容が正しいのかそうでないのかは自分で判断する必要があります。

無料ブログ

最も簡単な方法ですが出来る事より出来ない事の方が多いです。以下は管理人があまりお勧めしない理由です。

理由1

ユーザーに高評価されるページは Google検索結果の 1ページ目に表示されます。Googleが評価する対象はURL、つまりドメインネームに対して行われるので評価されるのはブログの筆者ではなく無料ブログを提供している業者になります。

このことが問題となるのが他のブログやレンタルサーバーなどに移転するときです。無料ブログは 301リダイレクトができないので、それまで時間をかけて築き上げた評価を引き継ぐ事が出来ません。

移転すれば URLが変わるのでGoogle検索から消えてしまいます。移転先にブログの本文を写しても Googleはコピーコンテンツと判断する可能性が高く、そうなると検索結果に表示されるのは難しくなります。また1からやり直しです。

理由2

後述しているGoogle Search Consoleで XMLサイトマップ送信に数カ月を要することがあり、ウェブマスター ヘルプ フォーラムでこの相談をよく見かけます。

XMLサイトマップは Googlebotのサイト内クローリングを補助するファイルで拡張子は .xmlです。サーバーのルートディレクトリに設置します。拡張子が .htmlの HTMLサイトマップとは用途が異なる別物です。

無料ブログを選択する場合は将来的に移転の可能性がある等、この先どうしたいのかを後悔しないようによく考えることです。

インターネットの仕組み

全てを理解する必要はありませんが、なぜドメインネームの取得とDNSサーバーへの登録が必要なのかくらい理解しておけばドラブルの際の悩みや迷いが1つ減ります。

レンタルサーバーで独自ドメインを使う場合いずれもサイト公開前にレジストラと呼ばれるドメイン登録業者から購入、手続きする必要があります。

インターネットやネットワークの仕組みを知ることで自ずとサイバーセキュリティの知識も身につきます。

中古ドメイン

いちど使用されていた独自ドメインの登録が抹消され再び販売されているものが中古ドメインです。

ゆえにGoogleの評価が付いていますが、高評価の物もあれば手動対策(ペナルティ)を受け解除されないままのものもあります。

後者を使ってしまうとどんなに高品質のコンテンツであっても検索順位が上がるどころか表示さえされない事になります。ドメイン履歴を調べる方法もありますがGoogleの評価までは判別できません。

サイトを公開していきなり手動対策を解除しなければならない、あるいはドメインを変更しなければならない羽目になります。時間と費用のムダですね。

ウェブマスターヘルプフォーラムを見る限り手動対策解除の合否は人が判断するようで、申請書など決まった書式がないので審査をクリアするのはかなり難しいです。

よく考えてくださいね。評価の高い価値のあるドメインを簡単に捨てるでしょうか?否、捨てざるを得ない事情があるから捨てるのです。

中古ドメインは、プロが目的をもって使用するものであり素人が安易に手を出すべきではありません。Google検索結果に表示しなくてもよい、つまりインデックスされなくてもよい場合は購入してよいと思います。

もう1つ、レジストラによっては中古ドメインと謳わずに売られている場合もあるので購入の際は一応履歴を調べて新規ドメインである事を確認しましょう。

CMSを使う前に

ウェブページデザインを構築し装飾を施してウェブブラウザにレンダリング(描画)するための言語がHTMLとCSSです。

これらの知識が皆無でも現在は CMS(Content Management System)というアプリケーションソフトがあるので誰でも簡単にウェブページを構築できます。

中でもWordPressが代表的なCMSですね。とても便利なものですが誰でも簡単に出来るがゆえの問題もあり、例えばセキュリティに対する意識がないまま、また各種機能を理解しないまま使ってしまうことですね。

ヘッダータグ <head>~</head> の意味と書込まれる内容くらい覚えておくとトラブルの際、問題解決の一助になるはずです。

それとこれは大した事ではないですがどのサイトも同じ様なデザインで、例えばSEO的に一等地であるはずのページ冒頭に意図が分からない大きな画像が貼ってあるのでスクロールしないと本文が読めない。

ユーザー エクスペリエンスを損ねているのでテーマは慎重に選んだほうがよいと思います。

デザインの話が出たのでついでに。サイトはレスポンシブ ウェブ デザインで作成すると管理が楽で良いことが多く Googleも推奨していますが必須ではありません。

レスポンシブ ウェブ デザインとは 1つのHTMLとCSSでパソコンとモバイル端末に対応する構築方法

プラグインについて

CMSを使う上でアドバイスを1つ。プラグインの導入はほどほどにしておかないと、入れたら入れた分だけ相互干渉の確率が増え、CMSの分も含めたセキュリティホールも増えていきます。

ウェブマスター ヘルプ フォーラムで散見するのが クラッキング(ハッキングした上に不正なコードを埋め込む改ざん行為)されたことへの相談です。

何故かことごとく WordPressのサイトなのです。

この不正なコードを Googlebotが発見すると検索結果のページタイトルの下に「このサイトはコンピュータに損害を与える可能性があります」や「このページは第三者によってハッキングされている可能性があります」など表示されます。

こなるとユーザーからの信用はダダ下がりです。この場合 HTTPと TLS(HTTPS)の違いはありません。ハッキングの度合いによってはサイトを閉鎖せざるお得ない状況にかるかもしれません。

参考までに、管理人は以前 ハッキングされたサイトを調べた ことがあるのでよかったら覗いてみて下さい。

正規URLを決める

ドメインネームを購入してサイトを公開すると少なくとも下記4つの異なるURLで同じサイトにアクセスできてしまいます。当初から TLS(HTTPS)で作成した場合2つです。

- http://www.homepage.com

- http://homepage.com

- https://www.homepage.com

- https://homepage.com

これを重複したURLと呼び、後述している Google Search Consoleに全てのURLを登録します。その際どれか1つを正規のURLとして定義する必要があります。

効率よく登録手続きを済ませるためにも予め決めておきます。

ホスト名(wwwの部分)はサイトによって違ってきます。例えば、info ,ftp など。

下記は Search Consoleヘルプ からの抜粋です。

“ ...(前略)コンテンツと品質を評価するための主なソースには正規ページが使用されます。また、Google 検索では、通常は正規ページが検索結果に表示されます。ただし...(後略)”

この他、ヘルプのページには「正規 URL の指定が重要な理由」が掲載されているので一読をお勧めします。

☺ 補足|ページが重複している時の正規化

ページが重複しているとは URLが違うのに内容が似ている、あるいは全く同じであるコンテンツを指します。このような場合どちらかのページを正規URLに設定するためヘッダー内に <link> canonicalを記述します。

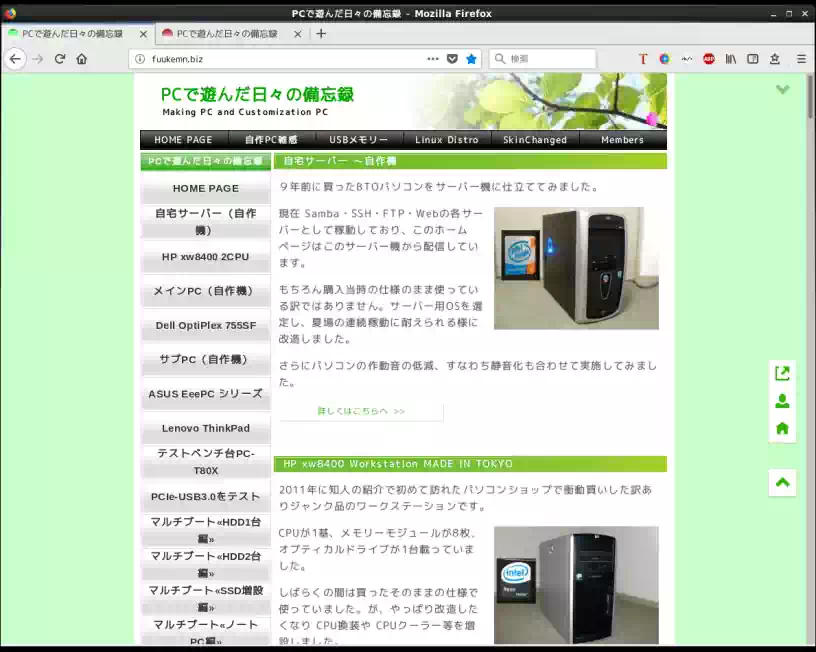

例えば、管理人は自宅サーバーから URLのホスト名が異なる 2つのサイトを公開しています。両者は下の画像のようにコンテンツが 100%同じでデザインのみ異なっています。

いわゆる重複コンテンツとかコピーコンテンツと呼ばれる状態です。

下記のように 2つのサイトの全てのページに正規ページとコピーページが 1対1になるように記述しています。

正規ページ(http://www.fuukemn.biz/ page1.html)のヘッダーに正規URLを入れる

HTML:

<head>

<link rel="canonical" href="http://www.fuukemn.biz/page1.html">

</head>

コピーページ(http://info.fuukemn.biz/ page1-copy.html)のヘッダーに正規URLを入れる

HTML:

<head>

<link rel="canonical" href="http://www.fuukemn.biz/page1.html">

</head>

注意するポイントは URLを絶対パスで記述することです。相対パスで試してみると両方共インデックスされてしまい効果がありませんでした。

| 相対パス | www.fuukemn.biz/page1.html ← ☓ |

|---|---|

| 絶対パス | http://www.fuukemn.biz/page1.html ← ○ |

以上の設定により検索botは無駄なクロールをしなくなるのでサーバー負荷の低減と正規URLのクロール頻度が増える効果があります。

レンタルサーバー選び

レンタルサーバーには専有と共有があり一般的には後者を契約してウェブサイトを構築すると思います。

「レンタルサーバー 選び方」で検索すれば情報が溢れているのでここでは多くを語りませんが契約前に是非確認しておきたい事を1つだけ紹介します。

それは「301リダイレクトを許可している」のか否かです。サーバーを移転したりドメインを変更した時、Googleのサイト評価を確実に引き継げる方法は 301リダイレクトだけです。

javascriptによるリダイレクトでは「引き継げることもある」程度です。無料ブログのセクションでも述べていますがこれが出来ないとそれまで築き上げたものが全て消えてしまうことになります。

出来ればこの先サイトを閉鎖する時まで移転や変更などしなくて済むようによく考えた方がよいです。

自宅サーバー

全て自前なので公序良俗に反しない限りやりたい放題、何でもありのサーバーです。

しかしそれを享受するためにはネットワークとサイバーセキュリティ、パソコンの仕組み、OSの仕組み、サーバー サイド アプリケーションなど多岐にわたる知識と根性が必要です。

サイト公開に必要なサーバー

ウェブサイトは Webサーバーの他に SSHサーバー、FTPサーバーを構築しドメインネーム取得とDNS登録すれば公開できます。

| Web サーバー | インターネットからのリクエストに答えてサイト内のページを返信する |

|---|---|

| SSH サーバー | 通信を暗号化して外出先から自宅サーバーにアクセスする |

| FTP サーバー | HTMLファイルやCSSファイルなどをローカルマシンからアップロードする。外出先からアップロードする場合はSSHと組み合わせる |

| DNS サーバー | グローバルIPアドレスをFQDN(完全装飾ドメインネーム)に名前解決するためのサーバー |

1台のパソコンにOS(Linuxディストリビュージョン)を導入し、上表の各サーバーを 構築します。CentOS , Debian , Ubuntuのいずれかのサーバーバージョンを使用します。

サイト公開に必要な機器

ウェブサイト開設前に用意する機器類は FTTH通信 1回線、業務用有線ルーター1台、サーバー用とリモート接続用のパソコン各1台です。

よくネット上で自宅サーバー用のパソコンの性能は低くてよいなど見かけますがそんなことはなく、性能高いに越したことはありません。

ルーターの80番あるいは443番ポート、SSHポートを開放した途端に世界中の検索botやアフィリエイトbot、ポートスキャン、ブルートフォースアタックなどが押し寄せてくるのでこれらを処理しつつ高速配信を続けなければいけません。

ページが表示されるまで 3秒以上かかるようなサイトは誰の目にも低評価です。アクセス拒否の設定に時間を取られるくらいなら最初から高性能のスペックを選んだ方が建設的でしょということです。

サイト公開に必要な IPアドレス

グローバルIPアドレスは動的(ダイナミック)IPでも固定IPでもどちらでもよいですが、TLS(HTTPS)で無料のサーバー証明書を使う場合やDNSサーバー、メールサーバーを運用する場合は固定IPが必須です。

当サイトは ISPから付与される動的IPアドレスを 無料のダイナミックDNS に登録してHTTPで配信しています。

この方が比較的構築し易く、ランニングコスト(ドメイン更新料金と電気料金くらい)も安いので初心者にはお勧めです。

セキュリティ

サーバーとルーターに関するごく初歩的なセキュリティについて こちらのページ に掲載しています。

サイト公開後にやること

作成した .htmlファイルを Webサーバーのルートディレクトリ、あるいはその配下のディレクトリに配置すればウェブページとしてインターネット上に公開されますがその存在は誰にも知られていません。

知ってもらうためには Googleや Yahoo、Bingなどの検索結果に表示してもらう必要があります。

Google検索結果に表示される仕組み

Googlebot(クローラー)がURLを発見したらサイトをクロールして該当するページをデータベースに一旦インデックス(登録)し、独自の評価軸(アルゴリズム)でその品質を評価します。

その上で低品質なコンテンツ(重複、コピー、スパム)のページは削除され、そうでないものが残り、コンテンツの質の度合いによって順位を決定し検索結果に表示される仕組みです。これは管理人の経験からも合点がいきます。

裏を返せば URLが発見されなければどんなに高品質なコンテンツでも永遠に日の目を見ないサイトになる?というのは言い過ぎですが、発見されるまで相当の時間がかかるのは間違いありません。

Google Search Consoleへ登録

Googleにいち早くウェブサイトの存在を知らせる方法です。下記は Search Console ヘルプからの抜粋です。

“ Google Search Console は、Google 検索結果でのサイトの掲載順位を監視、管理、改善するのに役立つ Google の無料サービスです。Search Console に登録しなくても Google 検索結果にサイトが表示されるようにすることはできますが、Search Console に登録することで、Google のサイトに対する認識を理解し、改善できるようになります。”

登録には Googleアカウントの取得が必要です。その上で前述の「正規URLを決める」のセクションに上げているURL(Search Consoleではプロパティと呼んでいる)の全てを登録します。

その中から 1つだけ正規URLを設定します。この辺りの詳細は Search Console ヘルプ を熟読する必要があります。

所有権の確認の手続き

所有権の確認とは、 Search ConsoleにURLを登録した時のアカウントとウェブサイトの所有権が合致することを確認するプロセスです。

この手続きを踏まないと登録したサイトの各種データを見ることはできてもダウンロードやアップロードはできません。この所有権を得るための手続きが Search Consoleで提供されるトークン(ソースコード)を登録したサイトに置くことです。

その代表的な方法を以下に掲載しますが、くれぐれも詳細は上述のヘルプページを熟読してください。

HTMLファイルをサーバーに置く方法

トークンは HTMLファイルで提供されます。当サイトではファイル名が「提供された英数文字列.html」で以下のコードが記されています。

google-site-verification:提供された英数文字列.html

このファイルをウェブサーバーのドキュメントルートに設定されているディレクトリ(フォルダ)にアップロードするだけです。

ホームページにコードを記入する方法

ホームページのヘッダー部である <head>~</head>の間にメタタグとして以下のように記入します。

HTML:

<head>

<meta name="google-site-verification" content="提供された英数文字列">

</head>

この場合のホームページとは一般的に index.htmlを指します。

サイト移転の前に知っておきたいこと

サイト移転とはウェブサイトを配信するサーバーを変更する、または HTTPを TLS(https)に移行する、あるいは両方同時に行うことです。必然的に URLも新しくなります。

移転後に必ずやらなければいけないのが 301リダイレクトです。これは旧サイトの評価を新しいURLに引継ぐためです。

設定は共有(レンタル)サーバーですと .htaccessファイルを、当サイトのような自宅サーバーでは httpd.confファイルを編集します。

ここで疑問に思うのは「設定するのはよいが、では一体どれくらいの期間継続すればよのか」です。ウェブマスター ヘルプ フォーラムのエキスパートの方々は 1年~半永久的にと回答しています。

結局、自分のサイトを分析して自分で判断しなければいけないようですね。

Search Consoleで知っておきたいこと

使用にあたり留意するべきことが 2つあります。1つめは検索パフォーマンスなどのツールはオンタイムのデータではなく反映されるまでタイムラグがあること。

2つめはデータの結果は傾向を見るものと捕らえて数値にこだわりすぎないことです。あまり固執するとコンテンツ作りに支障をきたして本末転倒なことになります。

ページのコントロールを理解する

ウェブマスター ヘルプ フォーラムに投稿された、ページの削除や非表示の設定で誤った使い方が多い項目です。

古いコンテンツの削除

サーバーがステータスコード 404を返しているページが検索結果に表示されている場合、キャッシュ削除を以来する。

URL削除ツール

ページを 90日間、一時的に検索結果から非表示にする。期間満了後に再び表示される。

content属性 noindex

ページをインデックスさせたくない時 HTMLファイルのヘッダー内に <meta> noindexを記述する。検索botがクロールすることで有効になるのでページやディレクトリをブロックしてはいけない。

robots.txtファイル

クロールさせたくないページやディレクトリを記述してサーバーのルートディレクトリに置き、検索botをブロックする。

故に上記 noindexと併用する時はクロール後にアップロードする。ただし、ブロックしても外部からリンクされているとインデックスされる。その時は Search Consoleにメッセージが届く。

これらは サイトを運営していく中でよく使うことになるのでヘルプを参照して用途を理解しておいた方がよいです。

ヘルプに載っていないこと

これもウェブマスター ヘルプ フォーラムで目立つ相談や質問です。

TLS(https)に移行した後、httpプロパティを削除しない

削除するとデータは戻りません。インデックス移行の推移が確認できなくなり、トラブル時の原因究明や対処がやりにくくなります。

スパムリンクは自動的に無効化される

サイトのカテゴリと関係のない被リンクは無効化され、いずれ削除されます。これは実際に経験しました。詳細は こちら

インデックス後のGoogleダンス

新規ページがインデックスされた直後は検索結果上位に表示される。2~3日後に検索結果から消えるが1週間後くらいに再び下位表示される。

その後、1ヶ月~6ヶ月くらいかけてじわじわ順位が上昇し、やがて安定する。この1~2年で起きている当サイトの挙動です。

これとは少し違いますが こちら に実際に起こった現象のドキュメントを掲載しています。

画像のalt属性

画像検索結果に表示される画像をクリックしたとき altの文言(画像の説明文)が表示されます。これがないとユーザーは何の画像か分からないのでサイトを訪問してくれません。

はてなブログの XMLサイトマップは認識されにくい

いつまでも保留の状態が続くがインデックスはされている。info:URL検索やURL検査で確認できる。

httpよりhttpsを優遇する

Googleが公言していることですが間違えてはいけない事は「コンテンツの品質が同じならば」ということです。圧倒的なオリジナリティがあれば関係ありません。

TLS(https)を理解する

ユーザーエージェント(ウェブブラウザ)とサーバー間の通信が暗号化されるだけなので、被ハッキング(キーロギング、不正アクセス改ざん)については httpと同じです。

手動による対策の通知

自サイトの評価を上げるためにリンクを売買したり Googlebotを欺く行為、他サイトへの著作権侵害やスパム行為などガイドラインに違反した場合 Search Consoleに通知が来ます。

意図して行っていなくても適用されページ単位またはサイト全体に実施されるので検索結果から排除されます。これを解除するためには厳しい再審査を受けて合格しなければいけません。

あきらめてドメインを捨ててしまうケースも少なくないようで、これが中古ドメインとして出回り事情を知らずに買ったサイトに通知が来るケースもあるようです。

ウェブマスター ヘルプ フォーラムで個人や法人などの相談を見ていると、解除までにはかなりの時間がかかっていました。

そうならにためにも何がガイドライン違反になるのか こちらのヘルプ の 12項目を正しく理解しておきましょう。

まとめ

これらをサイト公開前に知っているのとそうでないのとでは心の持ちようが全然違います。トラブルの原因切り分けに役立つので時間を無駄に費やすこともなく、コンテンツ作りに集中できます。

結果的に検索ランキング上位に、つまり検索結果の 1ページ目に表示される確率が上がると思います。

これは余談ですが Search Consoleのことを SC とか サチコ と表現していることがあります。分かりにくいですね。公開コミュニティで省略形はやめてほしいものです。

雑感

これまで経験したことを思いつくままに、つらつらと書いてみました。気の向くままにまとめてしまったので分かりにくいところが多々ありますが、そこはご容赦。

最後に、下記は Search Console ヘルプからの抜粋です。

“ Google のアルゴリズムは常に改善されています。アルゴリズムを推測して、それに合わせてページを設計しようとするのではなく、ユーザーが望む良質で新鮮なコンテンツを作成し、ガイドラインに準拠してください。”

ウェブサイト作りのマニュアルはこれに尽きると思いますよ。